Neuralink вернул голос пациенту с ALS

Авторы: Neuralink

Кеннет Шок раньше комментировал гонки в Mario Kart вместе с детьми. Потом ALS забрал его голос. К моменту, когда в январе 2026 года ему вживили имплант Neuralink, он несколько лет не мог произнести ни слова. Через несколько недель он снова заговорил — не набирая текст на экране, не моргая на буквенную доску, а вслух, своим собственным голосом, воссозданным AI из записей, сделанных до прогрессирования болезни.

Когда система впервые произнесла «I love you» его голосом, жена Шерил расплакалась.

Это уже не фантастика. Но и не рутинная медицина. Вот как это устроено.

Чип, который читает намерения

Нейрокомпьютерный интерфейс (BCI) — устройство, которое считывает электрические сигналы мозга и переводит их в команды: движение курсора, набор текста или, как в этом случае, речь. Мозг генерирует измеримые паттерны даже тогда, когда тело больше не способно действовать.

Имплант Neuralink N1 — чип размером с монету, размещённый на поверхности моторной коры — области мозга, отвечающей за планирование движений, включая движения языка, губ и голосовых связок. На нём — 1 024 электрода, распределённых по 64 ультратонким гибким нитям, каждая тоньше человеческого волоса. Хирургический робот R1 вводит нити с точностью до микрона, обходя кровеносные сосуды.

Электроды улавливают сигналы в диапазоне микровольт — крошечные колебания напряжения от работающих нейронов. Чип усиливает их, оцифровывает и беспроводно передаёт со скоростью более 200 мегабит в секунду. Никаких проводов, выходящих из черепа.

От нейронных искр к произнесённым словам

Когда вы думаете о том, чтобы сказать слово, нейроны моторной коры активируются по определённому паттерну — даже если мышцы уже не способны выполнить движение. Паттерн для «привет» отличается от паттерна для «вода». У пациентов с ALS моторная кора остаётся нетронутой, хотя нейроны, связывающие мозг с мышцами, отмирают.

Фонема — минимальная звуковая единица языка. В русском их около 42, в английском — 44. Слово «кот» состоит из трёх фонем: /к/, /о/, /т/. BCI-системы для речи сначала декодируют нейронную активность в фонемы, а затем собирают их в слова.

Декодирование речи в Neuralink проходит три стадии обучения. Сначала пациент произносит слова вслух, а система учится, какие нейронные паттерны соответствуют каким звукам. Затем пациент беззвучно артикулирует губами. Наконец — только думает о произношении, а система декодирует фонемы напрямую из активности мозга.

Модель машинного обучения сопоставляет нейронные паттерны с фонемами, собирает фонемы в слова и передаёт их в синтезатор речи. Но на выходе — не безликий компьютерный голос.

Призрак голоса

Вот деталь, которая делает эту историю личной, а не просто технической. До того, как ALS лишил его речи, Кеннета записывали — домашние видео, голосовые сообщения, случайное аудио 2020 года. Команда Neuralink нашла эти записи и обучила на них модель AI-клонирования голоса. Результат — синтетический голос, звучащий так, как Кеннет говорил до болезни. Внутри команды его называют «Original Ken».

Вот как работает вся цепочка: Кеннет думает о том, что хочет сказать. Моторная кора активируется. Чип N1 перехватывает сигнал. Декодер превращает его в фонемы. Синтезатор произносит слова — голосом Кеннета.

AI-клонирование голоса берёт образец чьей-то речи (иногда хватает нескольких минут аудио) и строит модель, способную генерировать новую речь тем же голосом, с тем же тембром и каденцией. Это не воспроизведение записей — система синтезирует предложения, которые никогда не были произнесены.

Система пока не мгновенная. Между мыслью и звуком заметна задержка, встречаются ошибки декодирования. «Мы хотим построить систему, которая идёт напрямую от мозга к голосу в реальном времени», — признал руководитель проекта, подтверждая, что текущая версия до этого не дотягивает.

Кто ещё работает над речевыми BCI

Испытание Neuralink VOICE (зарегистрировано как NCT07224256) получило статус FDA Breakthrough Device в мае 2025 — это означает, что агентство считает технологию потенциальным прорывом для ALS, инсульта и травм спинного мозга. Кеннет Шок — один из первых участников. Текущий этап — early feasibility study: оценка безопасности и начальной эффективности, а не доказательство масштабной работоспособности.

Neuralink не опубликовал рецензируемых результатов по испытанию VOICE. Демонстрация основана на публично доступном видео и заявлениях компании.

Neuralink — не единственные. Академические группы работают над BCI для речи уже больше десяти лет. В 2023 году Стэнфорд опубликовал высокопроизводительный речевой нейропротез в Nature. В 2024 году команда BrainGate продемонстрировала синтез речи в реальном времени у хронически имплантированного пациента с ALS — точность 97%. В 2025 году показали стабильное декодирование из речевого BCI без рекалибровки в течение трёх месяцев.

Что отличает Neuralink — аппаратная часть: полностью беспроводной имплант высокой плотности, не требующий внешних разъёмов или проводов. Synchron, другой конкурент, предлагает менее инвазивный вариант — стент-подобное устройство, введённое через яремную вену без трепанации, но с меньшим числом электродов. Paradromics, третий игрок, получил разрешение FDA на начало испытаний по восстановлению речи в 2025 году.

Пять вопросов без ответа

Как долго работает имплант? У первого пациента Neuralink (Норланд Арбо, испытание PRIME, 2024) через несколько месяцев произошло частичное отслоение нитей. Работает ли N1 стабильно годами — неизвестно.

Говорит пациент или AI? Этот вопрос звучал в каждой публичной дискуссии. Декодер переводит намерения мозга, но клонирование голоса добавляет слой синтеза. Для пациентов без сохранённых аудиозаписей доступен только стандартный голос — а это вопрос идентичности и аутентичности.

Можно ли достичь скорости реального разговора? Текущие задержки мешают естественной беседе. Декодирование в реальном времени на скорости обычной речи (около 150 слов в минуту) остаётся целью.

Как быть с эмоциями? AI-голос произносит слова, но не передаёт тон, ударения, гнев или печаль. Один наблюдатель заметил: «Представьте, что вы никогда не сможете выразить злость или грусть интонацией». Просодия — мелодика речи — остаётся открытой исследовательской задачей.

Станет ли это доступным? Стоимость операции, импланта и поддержки публично не раскрыта. Для технологии, нацеленной на ALS (около 30 000 американцев в каждый момент времени), путь к массовой доступности пока неясен.

У Кеннета Шока нет ответов на все эти вопросы. Зато у него впервые за годы есть способ сказать детям, чтобы они перестали жульничать в Mario Kart — его собственным голосом.

Источники

Оригинал

Связанные

Читайте также

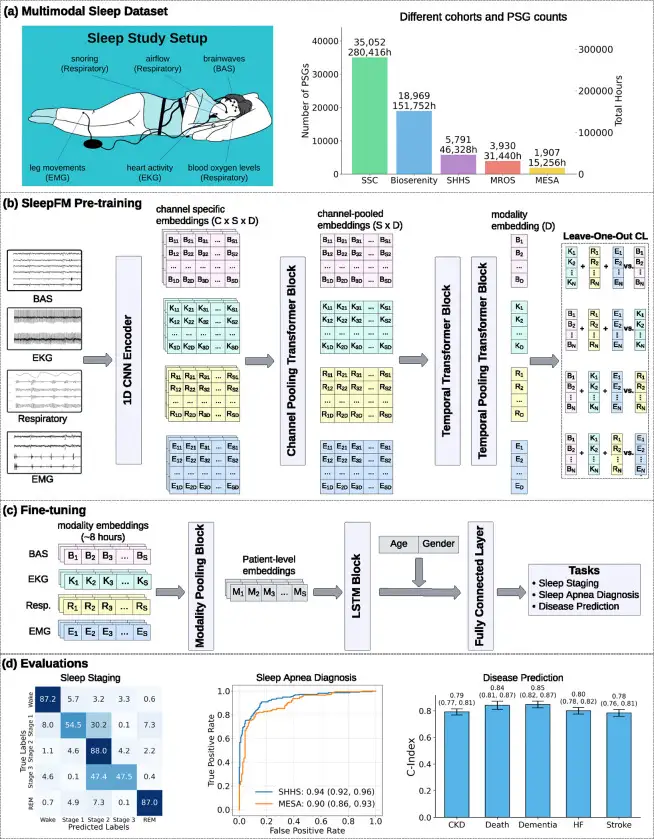

SleepFM: 130 болезней по одной ночи сна

Stanford обучил нейросеть на 585 000 часах сна. Она видит Паркинсон, деменцию и рак за годы до симптомов — по обычной полисомнографии.

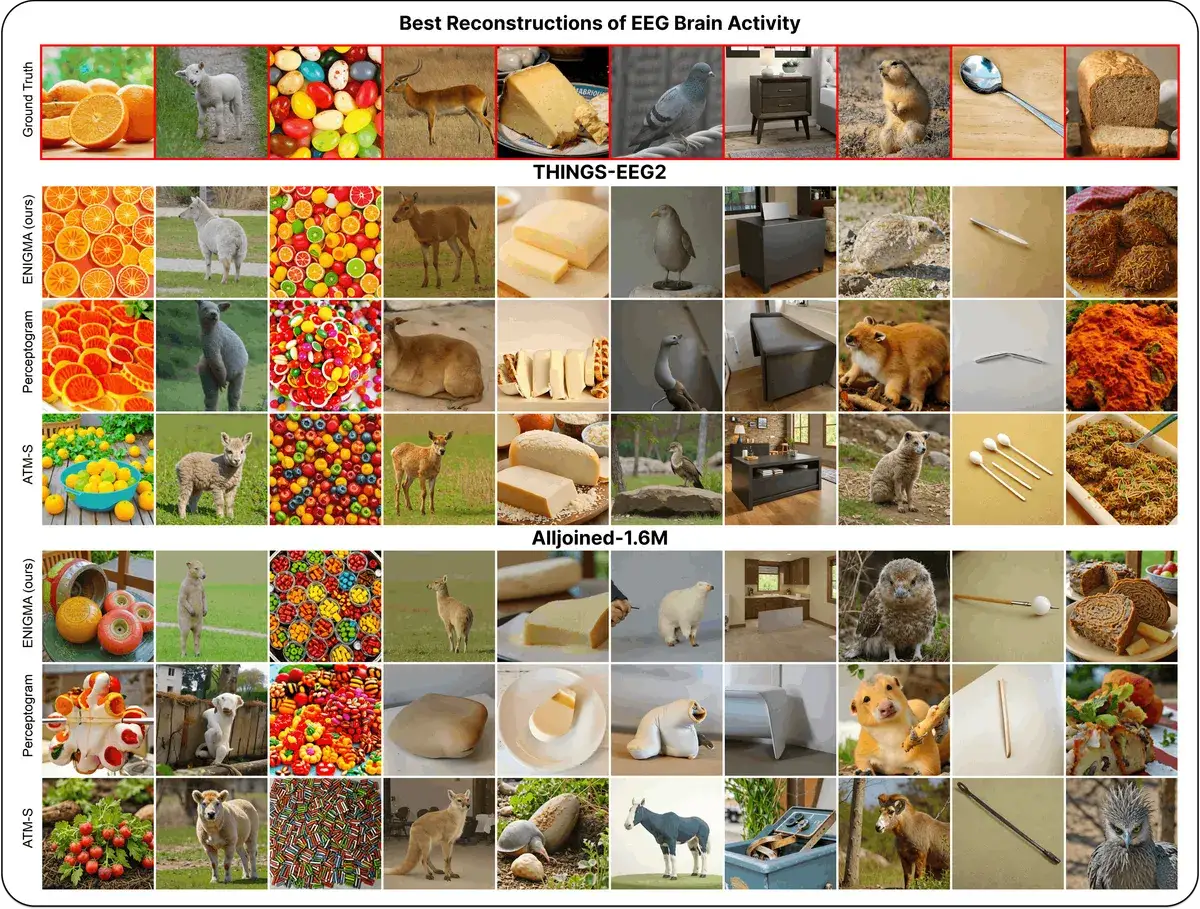

ENIGMA: чтение мыслей за 15 минут через ЭЭГ

Модель ENIGMA восстанавливает изображения из ЭЭГ за 15 минут калибровки, используя менее 1% параметров прежних подходов.

Печень, а не мышцы: как упражнения защищают мозг от Альцгеймера

Учёные UCSF нашли фермент GPLD1 из печени, который чинит гематоэнцефалический барьер после тренировки — и обращает потерю памяти у мышей с Альцгеймером.