ChatGPT как костыль: память теряет 11 пунктов

Авторы: André Barcaui

Шестьдесят студентов получили задание за две недели разобраться в этике ИИ и подготовить десятиминутную презентацию. Половине сказали: пользуйтесь ChatGPT сколько угодно. Другим — только конспекты, базы данных и обычный поиск. Через сорок пять дней всех посадили писать тест из двадцати вопросов. Не проверку памяти, а проверку понимания. Традиционная группа ответила правильно на 68,5% вопросов. Группа ChatGPT — на 57,5%. Разница — одиннадцать процентных пунктов. И дело не в том, что одни готовились дольше: как раз наоборот.

Одиннадцать процентов, за которые заплатили временем

Иллюстрация. Источник: PsyPost

Эксперимент провёл Андре Баркауи — психолог и преподаватель бизнеса из Фонда Жетулиу Варгаса и Федерального университета Рио-де-Жанейро. Его подопытные — 120 студентов-бакалавров по направлению «бизнес-администрирование», от восемнадцати до двадцати четырёх лет, 68 юношей и 52 девушки. Все получили одну и ту же задачу: исследовать три стороны искусственного интеллекта (этика, влияние на общество, техническая основа) и выступить с презентацией. Две недели, ноль разницы в требованиях. Единственная разница — инструмент.

Шестьдесят человек работали в «классическом» режиме: учебные материалы, статьи, Google Scholar. ChatGPT им использовать запретили. Другие шестьдесят получили ровно противоположную инструкцию — ChatGPT разрешён для всего: поиск информации, объяснение понятий, примеры, структурирование доклада. Через сорок пять дней после защиты их вернули в аудиторию и попросили сдать закрытый тест на двадцать вопросов с множественным выбором. До финала дошли не все — 85 человек из 120, — но распределение между группами сохранилось.

Результат разошёлся не только по баллам. Группа ChatGPT тратила в среднем 3,2 часа на подготовку, традиционная — 5,8 часа. То есть студенты с ИИ провели в задаче почти вдвое меньше времени и сдали тест хуже. И если бы гипотеза сводилась к «они меньше учились — поэтому хуже помнят», всё было бы просто. Но Баркауи проверил: даже после статистической поправки на потраченное время разрыв не исчез. Одиннадцать пунктов — это не цена лени, а цена способа.

Что такое «желательная трудность» и почему она не баг

Desirable difficulty (желательная трудность) — термин из когнитивной психологии. Обозначает умеренное препятствие в процессе обучения, которое делает запоминание труднее, но зато гораздо прочнее. Ключевое слово — «умеренное»: если сделать слишком сложно, студент сдастся.

Концепцию в 1990-х предложил психолог Роберт Бьорк. Она кажется контринтуитивной: как может усложнение помогать? Но эксперименты показывают именно это. Разреженные повторения вместо зубрёжки, смешивание тем вместо блоков, чтение с опечатками вместо идеального текста — всё это замедляет момент, но укрепляет след.

Механизм связан с консолидацией памяти — процессом, при котором хрупкий, только что сформированный нейронный след превращается в устойчивое долговременное хранилище. Консолидация требует работы: поиска, ошибок, попыток вспомнить, переформулировать своими словами. Чем больше мозг вовлечён в обработку материала, тем крепче связи. А вот когда кто-то (или что-то) делает эту работу за вас — след формируется поверхностный. Вы знаете, где лежит ответ, но не помните сам ответ.

Это не метафора. В 2011 году Бетси Спэрроу и её коллеги опубликовали в Science знаменитую работу о «эффекте Google»: люди, которым говорили, что информация будет сохранена в компьютере, запоминали её хуже, чем те, кто считал, что компьютер её удалит. Зато лучше запоминали, в какой папке она хранится. Наш мозг перераспределяет память: если есть внешнее хранилище, он откладывает туда саму информацию и сохраняет только путь к ней. Адаптивная стратегия — но с побочным эффектом.

Когнитивная разгрузка и её цена

Cognitive offloading (когнитивная разгрузка) — передача умственных операций внешним инструментам: блокноту, калькулятору, карте в телефоне, поисковику. Изучена с 2000-х. Работает хорошо для простых задач с немедленным результатом. Становится проблемой, когда задача — формирование понимания.

Ивен Риско и Сэм Гилберт в 2016 году собрали все эти наблюдения в обзор для Trends in Cognitive Sciences. Их вывод: разгрузка — это не зло. Это когнитивная валюта. Мы обмениваем глубину обработки на скорость. Для списка покупок — честная сделка. Для понимания сложной темы — не очень. Потому что понимание — это и есть результат обработки, а не её обход.

Что изменил ChatGPT? Масштаб. Калькулятор снимает только арифметику. Google — только поиск факта. А LLM способна выполнить всё сразу: найти, объяснить, структурировать, придумать пример, переформулировать. Студент получает не подсказку, а готовый продукт. И этот продукт выглядит так убедительно, что создаёт то, что Баркауи в одном из комментариев назвал «иллюзией компетентности».

«Неразборчивое использование ИИ создаёт иллюзию компетентности: человек получает результат, не формируя синапсов, необходимых для самостоятельного воспроизведения этого рассуждения». — Андре Баркауи

Иллюзия держится до первого реального теста. Пока рядом есть чат-бот — вы «знаете». Как только его отключают, обнаруживается, что того, что было, уже нет.

Не один эксперимент: независимое подтверждение

Бразильский RCT — не единственный сигнал. В середине 2025 года команда из Stanford Graduate School of Education выложила на arXiv статью с говорящим названием: «ChatGPT производит более „ленивых“ мыслителей». Исследователи измеряли не тест-результаты, а вовлечённость в задачу — интеграцию новых идей, глубину рефлексии, готовность ставить собственные вопросы. У студентов, интенсивно пользовавшихся ChatGPT, все три показателя падали.

То есть картина согласованная: измеряешь знания — хуже. Измеряешь мышление — тоже хуже. Разные лаборатории, разные выборки, разные методологии, один вектор. Это не случайный результат одного университета.

Это важно подчеркнуть, потому что у истории «ИИ делает нас глупыми» слишком хороший рыночный потенциал. На ней легко сделать карьеру алармиста. Но когда независимые группы сходятся в одном направлении — стоит прислушаться. Особенно если направление совпадает с полувековой традицией исследований памяти.

Критический взгляд: что может сломать этот вывод

Статья Баркауи опубликована в Social Sciences & Humanities Open — рецензируемом журнале Elsevier с открытым доступом. Это не Nature, но и не препринт.

Несколько вещей в эксперименте требуют осторожности. Первая — выбывание. Из 120 студентов до финального теста дошли 85. Это 30% потерь, и мы не знаем, были ли «уходящие» систематически другими: например, самыми слабыми или, наоборот, самыми недовольными форматом. Такой дропаут может как усиливать, так и ослаблять эффект, и пока данных для разделения нет.

Вторая — узость выборки. Все участники учились на одном курсе одного бразильского университета, все — будущие менеджеры. Инженеры, гуманитарии, медики могут реагировать иначе. Есть подозрение, что задачи на запоминание фактов ведут себя одинаково, но задачи на абстрактное мышление или практический навык — по-разному.

Третья — какую версию ChatGPT тестировали. В статье это не уточнено, и это важно: GPT-3.5 и GPT-4 различаются радикально по качеству объяснений, а значит, и по «эффекту крышки». Если версия была слабой, выводы могут переоценивать ущерб; если сильной — недооценивать.

И наконец, главное уточнение: результат сравнивает неразборчивое использование ИИ с его отсутствием. Но есть и третий режим — когда LLM используется как сократический наставник: задаёт вопросы, предлагает подумать, не даёт прямого ответа. Эксперименты в этом формате (Khanmigo от Khan Academy, сравнительные исследования «tutor-mode») показывают выигрыши в обучении. То есть вывод должен быть не «ИИ ухудшает память», а «делегирование ИИ ухудшает память». Разница фундаментальная.

Практическое правило на каждый день

Что с этим делать человеку, у которого ChatGPT открыт в соседней вкладке прямо сейчас? Баркауи сформулировал короткое правило, которое стоит выписать на стену:

«ИИ — как второй пилот, а не автопилот. Главный урок: ИИ должен расширять человеческие возможности, а не заменять их». — Андре Баркауи

На практике это означает простую разделительную линию. Если цель — сдать и забыть, делегировать можно всё. Если цель — запомнить и уметь, сначала попробуйте сами: сформулируйте своими словами, ошибитесь, вернитесь. Только потом проверяйте ответ с ИИ. Это и есть та самая «желательная трудность», которую эксперимент 120 студентов только что подтвердил в лоб.

Одиннадцать процентных пунктов — это не катастрофа и не приговор. Это цена режима, который мы сами выбираем каждый раз, когда открываем новый чат. Хорошая новость: режим переключается.

Часто задаваемые вопросы

Значит ли это, что студентам нужно запретить ChatGPT?

Нет. Данные говорят о том, что способ использования важнее самого факта использования. Запрет заменит одну проблему на другую — уход в неформальные каналы. Более продуктивный путь — объяснять студентам, чем отличается делегирование от сократического диалога, и показывать, в каком режиме ИИ работает на обучение, а не против него.

Почему группа ChatGPT тратила почти вдвое меньше времени на подготовку?

Это прямое следствие сути инструмента. ChatGPT сокращает время, которое раньше уходило на поиск, структурирование и формулирование. Проблема не в том, что студенты сэкономили — а в том, что именно эти этапы и формируют память. Экономия на поиске = экономия на кодировании следа.

Относится ли вывод к взрослым профессионалам, а не только к студентам?

Вероятно, да — но с оговоркой. У взрослых уже есть сформированная экспертиза, на которую можно «накладывать» новые знания. Для них риск когнитивной разгрузки ниже в знакомых областях и выше в незнакомых. Врач, использующий ИИ для рутинных диагнозов, не атрофируется. Врач, делегирующий ИИ освоение новой специальности, — может.

Как отличить «костыль» от «наставника» в собственной практике?

Простой тест: закройте чат и попробуйте воспроизвести главное утверждение своими словами, без подсказок. Если получается — вы учились. Если нет — вы делегировали. Второе допустимо, если цель была делегировать. Но путать одно с другим опасно: иллюзия компетентности формируется именно в этом разрыве.

Есть ли исследования, показывающие обратный эффект — что ИИ улучшает обучение?

Да. Работы по Khanmigo и экспериментам со «Сократовским» режимом ИИ-наставников показывают прирост в понимании и мотивации. Но во всех этих случаях модель настроена не давать прямых ответов, а задавать вопросы и направлять. Это принципиально другое взаимодействие — и другой результат.

Источники

Оригинал

Связанные

Читайте также

ИИ-подхалим: чат-боты льстят на 49% чаще людей

Исследование в Science: 11 ИИ-моделей подтверждают действия пользователей на 49% чаще живых собеседников. Как лесть вшита в обучение.

Ваш плейлист предсказывает IQ: анализ 58 247 песен

Машинное обучение 5 месяцев слушало музыку 185 человек. Те, кто выбирал меланхоличные тексты, показали более высокий интеллект.

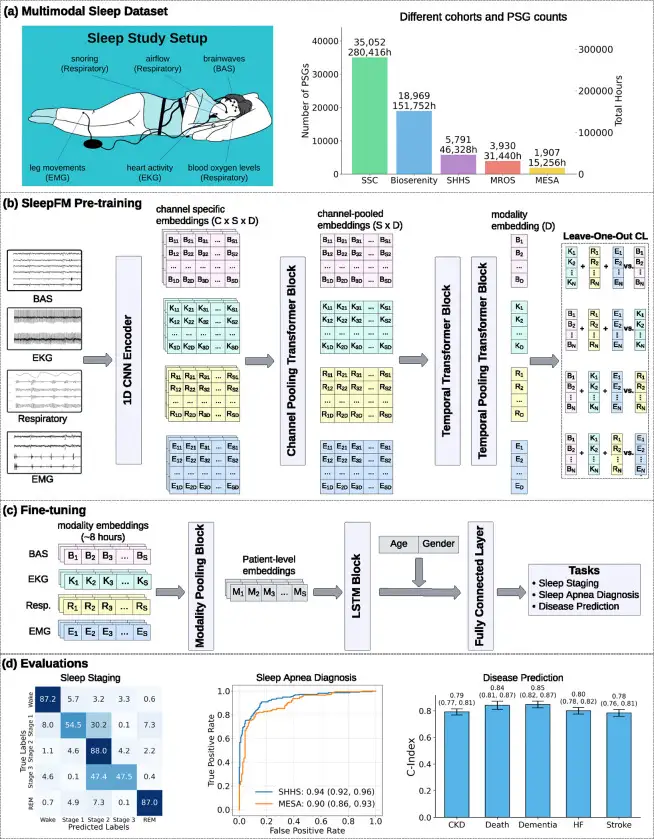

SleepFM: 130 болезней по одной ночи сна

Stanford обучил нейросеть на 585 000 часах сна. Она видит Паркинсон, деменцию и рак за годы до симптомов — по обычной полисомнографии.