75 000 прогнозов за матч: ИИ в футболе

Авторы: Michael Horton, Patrick Lucey, Vitaliy Kanev

Зачем это важно

Представьте: идёт матч Фулхэм — Астон Вилла, 62-я минута, красная карточка. Комментатор говорит «теперь всё изменится», но насколько именно изменится? Какова вероятность, что Фулхэм забьёт ещё? Сколько передач успеет сделать каждый игрок до финального свистка?

До недавнего времени ответы на эти вопросы были уделом интуиции экспертов и упрощённых статистических моделей. Но Майкл Хортон и Патрик Люси из Stats Perform — компании, стоящей за легендарной системой данных Opta — предложили нейросеть, которая отвечает на все эти вопросы одновременно. И делает это примерно 75 000 раз за матч с задержкой менее секунды.

Рынок AI-аналитики в спорте растёт стремительно: с $1,7 млрд в 2025 году до прогнозируемых $8,5 млрд к 2033-му. И эта работа — один из самых масштабных примеров применения трансформерной архитектуры к спортивному прогнозированию в реальном времени.

Основная идея

Ключевой прорыв этой работы — одна нейросеть, которая одновременно предсказывает 13 типов действий (голы, передачи, удары, фолы, угловые и др.) для каждого игрока, обеих команд и всего матча в целом.

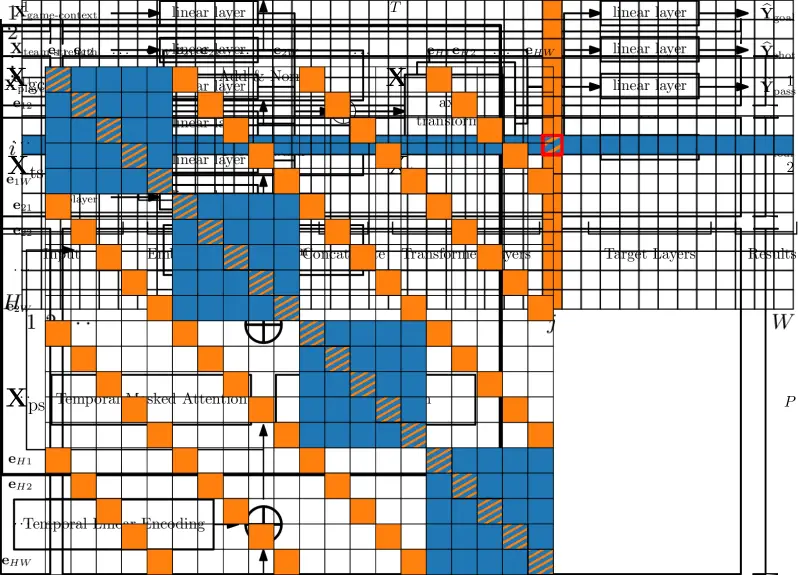

Axial Transformer — вариант архитектуры трансформера, в котором механизм внимания (attention) разделён на две оси: временную и пространственную. Вместо того чтобы каждый элемент «смотрел» на все остальные сразу (что дорого вычислительно), модель сначала анализирует связи вдоль одной оси, потом вдоль другой.

Если провести аналогию с шахматами: обычный трансформер — это ферзь, который видит всю доску. Axial Transformer — это ладья, которая сначала смотрит по горизонтали (время), потом по вертикали (игроки). Информация всё равно доходит до каждой клетки, но гораздо эффективнее.

Live-прогнозирование (in-game forecasting) — предсказание исходов и статистик не до матча, а по ходу игры, с обновлением после каждого значимого события (гола, фола, замены, углового).

Модель получает данные о текущем состоянии матча — счёт, время, позиции игроков, накопленную статистику — и предсказывает, чем всё закончится. Причём делает это не один раз, а обновляет прогнозы после каждого из ~150 событий за матч.

Как это работает

Рис. 1: Архитектура модели. Синим и оранжевым показаны маски внимания: строчное (временное) и столбцовое (между игроками) внимание. Источник: Horton & Lucey, 2025

Входные данные: пять типов информации

Модель принимает пять категорий входных тензоров:

- Характеристики игроков (live): позиция, команда, текущая статистика действий

- Сила игроков (pre-game): исторические данные за последние матчи

- Характеристики команд (live): агрегированные показатели действий

- Сила команд (pre-game): исторические показатели

- Состояние матча: тип последнего события, время, счёт, удаления

Двухосевое внимание: время × игроки

Главная инновация — взвешенное суммирование двух типов внимания:

-

Строчное внимание (temporal): каждый момент времени «смотрит» на все предыдущие моменты для одного агента. Это позволяет модели улавливать динамику матча: команда давит, прессингует, или наоборот — откатилась в оборону.

-

Столбцовое внимание (agent): в рамках одного момента времени все игроки и команды «видят» друг друга. Это моделирует взаимодействия: если вышел быстрый нападающий, защитники соперника получат больше работы.

Self-attention (самовнимание) — механизм, при котором каждый элемент последовательности «решает», на какие другие элементы ему стоит обратить наибольшее внимание. В контексте футбола: модель сама определяет, что удаление защитника в 62-й минуте важнее углового в 15-й.

Авторы математически доказали, что их подход эквивалентен стандартному последовательному самовниманию с определённой маской, но вычислительно значительно дешевле: O ((H+W)·H·W) вместо O (H²·W²).

Обучение

- Датасет: 62 610 матчей из 28 соревнований

- Обучающая выборка: 58 501 матч (сезоны 2016/17 — 2023/24)

- Тестовая выборка: 4 109 матчей (начало сезона 2024/25)

- Архитектура: латентное измерение 128, 4 слоя трансформера

- Обучение: ~15 часов на одной NVIDIA A10 GPU

- Оптимизатор: Adam с косинусным затуханием скорости обучения

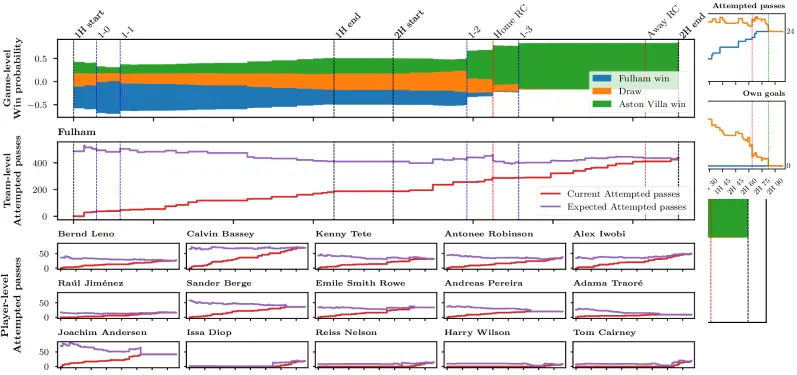

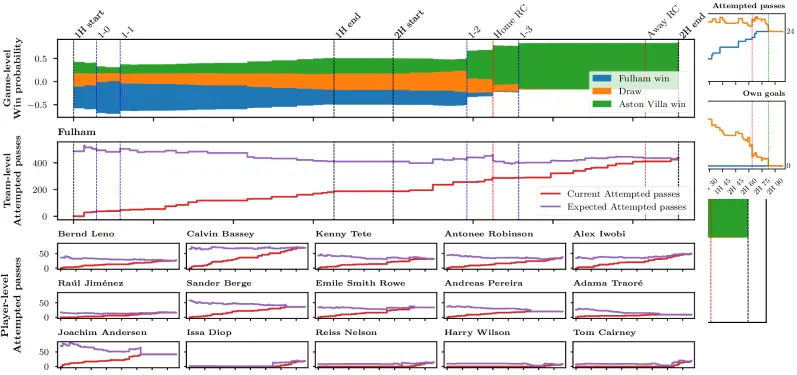

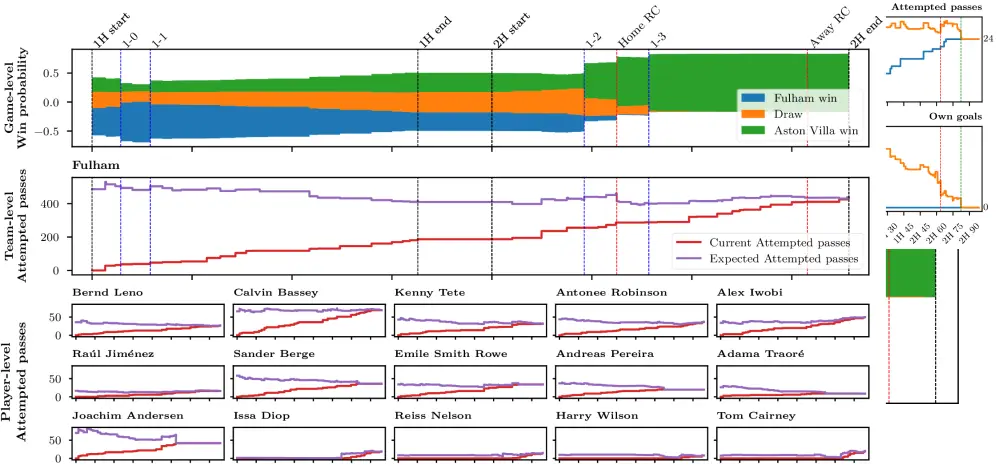

Рис. 2: Динамика предсказаний по ходу матча. Верхняя часть — временная шкала событий, нижняя — обновляемые прогнозы по ключевым метрикам. Источник: Horton & Lucey, 2025

Результаты

Масштаб предсказаний

Цифры впечатляют:

| Метрика | Значение |

|---|---|

| Прогнозов за один момент времени | ~505 |

| Событий за матч | ~150 |

| Всего прогнозов за матч | ~75 000 |

| Задержка | менее 1 секунды на обычном CPU |

Калибровка модели

Модель демонстрирует хорошо откалиброванные вероятности для большинства типов действий. Лучшая калибровка — для распространённых событий (голы, ассисты, передачи). Слабее — для редких событий вроде красных карточек (вероятность отсутствия красной ≥0,84) и высокочастотных действий вроде передач (большой диапазон значений снижает индивидуальные вероятности).

Рис. 3: Детальный анализ предсказаний на примере матча Фулхэм — Астон Вилла (19 октября 2024). Источник: Horton & Lucey, 2025

Абляционное исследование: что важнее?

Авторы протестировали пять вариантов модели, убирая разные компоненты:

- Полная модель — лучшие результаты

- Без межигрокового внимания — заметное падение качества

- Без временного внимания — ещё большее падение

- Без предматчевого контекста — значительное ухудшение

- Стековое (не суммированное) axial attention — чуть хуже полной модели

Вывод: и временная динамика, и взаимодействия между игроками критически важны для качества прогнозов.

Пример: Фулхэм vs Астон Вилла

В демонстрации на матче 19 октября 2024 года модель:

- До матча давала Фулхэму 47% вероятности победы

- После красной карточки на 62-й минуте мгновенно пересчитала ожидаемые показатели — снизила прогнозы по действиям оставшихся 10 игроков

- Корректно обнулила ожидания для заменённых и удалённых игроков

- Финальный счёт (Астон Вилла 3:1) показал, что Фулхэм действительно выступил хуже прогнозов

Критический взгляд

Сильные стороны:

- Масштаб и скорость: 75 000 прогнозов за матч с sub-second latency — это production-ready система, а не лабораторный прототип

- Единая модель: одна сеть решает все задачи (игрок/команда/матч), что упрощает поддержку и развитие

- Теоретическое обоснование: эквивалентность axial attention стандартному self-attention доказана формально, а не показана эмпирически

Ограничения:

- Только футбол: архитектура заточена под структуру футбольного матча (22 игрока, замены, удаления). Перенос на баскетбол или теннис потребует существенной переработки

- Зависимость от Opta-данных: модель обучена на 62 610 матчах с детальной разметкой от Stats Perform. Воспроизвести результат без доступа к таким данным практически невозможно

- Фиксированный набор из 13 действий: аспекты игры без мяча (прессинг, позиционирование, микродвижения) не входят в модель

- Калибровка редких событий: красные карточки и пенальти предсказываются заметно хуже частых событий

Открытые вопросы:

- Насколько устойчивы прогнозы при переносе между лигами с разным стилем игры (Серия A vs АПЛ)?

- Можно ли добавить трекинг-данные (координаты игроков) для улучшения предсказаний действий без мяча?

Это препринт arXiv, не прошедший формальное рецензирование. Авторы аффилированы с компанией Stats Perform, коммерчески заинтересованной в подобных технологиях.

Что дальше

Работа Хортона и Люси открывает несколько направлений:

Для индустрии: Модель уже может использоваться в ТВ-трансляциях (подсказки комментаторам), спортивных ставках (динамическая перекалибровка коэффициентов) и клубной аналитике (оценка решений тренера в реальном времени).

Для науки: Axial Transformer для спорта — это только начало. Следующие шаги могут включать:

- Интеграцию с компьютерным зрением (трекинг игроков из видеопотока)

- Расширение на другие виды спорта с аналогичной структурой «агенты × время»

- Мультимодальные модели, объединяющие event-data, трекинг и текстовые комментарии

Интересно, что параллельно развиваются другие подходы к «пониманию» футбола нейросетями: RisingBALLER трактует игрока как токен, а матч как предложение (аналогия с NLP), а OpenSTARLab предлагает открытый фреймворк для анализа спатио-темпоральных данных в футболе.

Мы наблюдаем рождение нового класса AI-систем — не просто предсказателей счёта, а цифровых аналитиков, которые понимают игру на уровне каждого паса, каждого фола и каждой замены. И делают это быстрее, чем вы успеваете моргнуть.

Часто задаваемые вопросы

Можно ли использовать эту модель для ставок на футбол?

Теоретически — да, модель генерирует вероятностные прогнозы, которые можно сравнивать с коэффициентами букмекеров для поиска «value-ставок». Но на практике букмекеры используют похожие (или даже более мощные) модели для формирования коэффициентов. Устойчиво обыграть рынок требует не только хороших прогнозов, но и поиска системных неэффективностей.

Почему модель плохо предсказывает красные карточки?

Красные карточки — крайне редкое событие (в среднем ~0.16 на матч). При такой частоте любая модель будет присваивать высокую вероятность отсутствию события. Это фундаментальная проблема дисбаланса классов, и авторы используют специальную функцию потерь (Poisson negative log-likelihood), но полностью решить проблему редких событий пока не удаётся.

Чем Axial Transformer отличается от обычного Transformer?

Обычный Transformer вычисляет внимание между всеми парами элементов, что при матрице «время × игроки» даёт сложность O (H²W²). Axial Transformer разделяет вычисление на две оси — по времени и по игрокам — и суммирует результаты. Это снижает сложность до O ((H+W)·H·W), сохраняя при этом математическую эквивалентность стандартному подходу с определённой маской внимания.

Работает ли модель для других видов спорта?

В текущем виде — нет, она спроектирована специально для футбола с учётом его структуры (11 на 11, замены, удаления, 13 типов действий). Однако принцип «axial attention по осям агентов и времени» универсален и может быть адаптирован для баскетбола, хоккея или других командных видов спорта с соответствующей модификацией входных данных и набора действий.

Нужен ли доступ к данным Opta, чтобы воспроизвести результаты?

Да, и это одно из главных ограничений работы. Модель обучена на 62 610 матчах с детальной event-разметкой от Stats Perform (Opta). Открытых датасетов такого масштаба и качества не существует. Для исследователей без корпоративного доступа возможны эксперименты на меньших открытых датасетах (StatsBomb Open Data, Wyscout), но результаты могут существенно отличаться.

Источники

Связанные

Читайте также

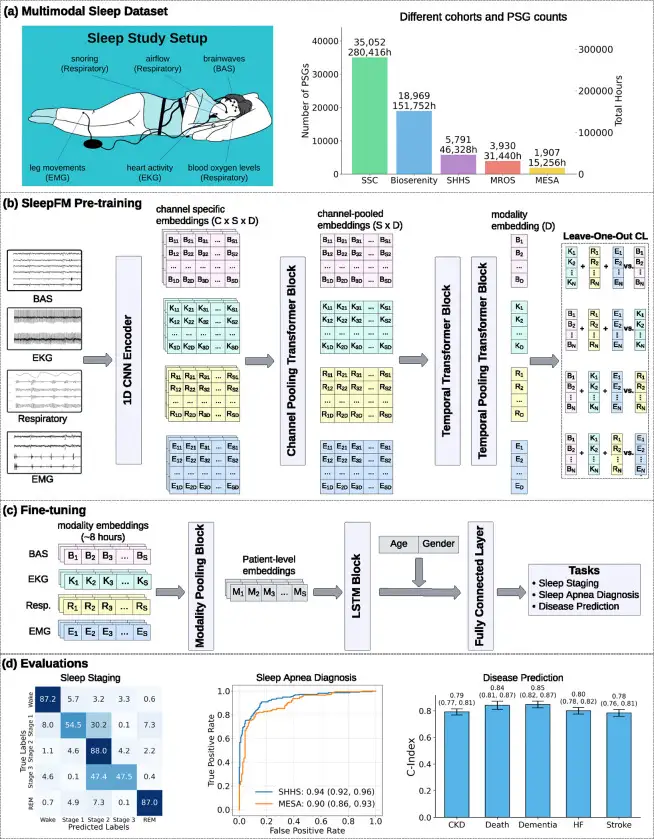

SleepFM: 130 болезней по одной ночи сна

Stanford обучил нейросеть на 585 000 часах сна. Она видит Паркинсон, деменцию и рак за годы до симптомов — по обычной полисомнографии.

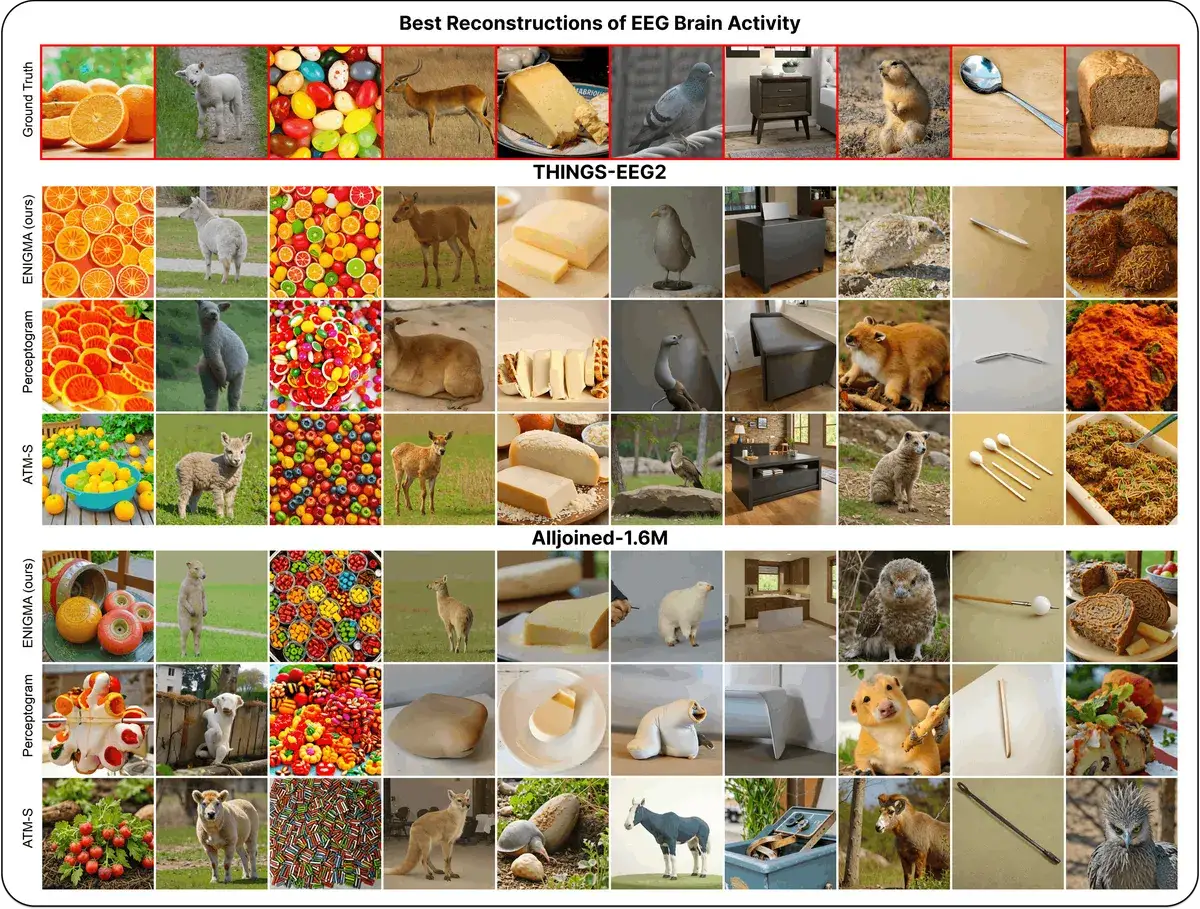

ENIGMA: чтение мыслей за 15 минут через ЭЭГ

Модель ENIGMA восстанавливает изображения из ЭЭГ за 15 минут калибровки, используя менее 1% параметров прежних подходов.

NVIDIA Cosmos 2026: ИИ, который учит роботов физике

Открытая платформа NVIDIA генерирует физически точные миры для обучения роботов. 12 млн GPU-часов, бесплатные модели.